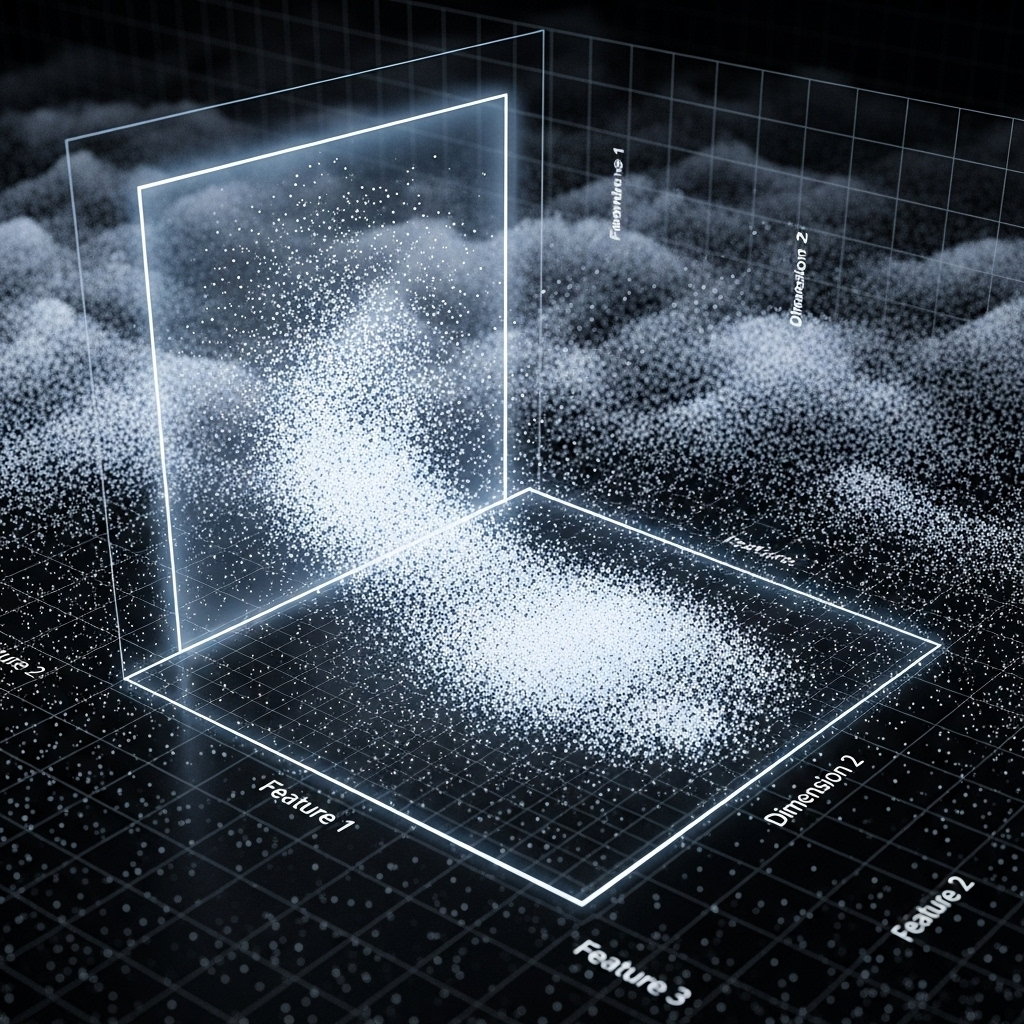

고차원 데이터는 인공지능(AI)에서 이미지, 텍스트, 센서 데이터 등으로 흔히 등장하지만, 계산 복잡도와 노이즈로 인해 분석이 어렵다. 차원 축소는 이러한 데이터를 저차원으로 변환해 효율성과 성능을 높이는 기술이다. 이 글에서는 고차원 데이터의 특징과 차원 축소의 주요 수학적 기법, 그리고 그 응용을 정리한다.

1. 고차원 데이터의 특징과 도전 과제

고차원 데이터는 많은 특성(차원)을 가지며, 예를 들어 28x28 이미지(784차원)나 단어 임베딩(300차원) 등이 있다. 주요 도전 과제는 다음과 같다:

- 고차원의 저주: 차원이 증가하면 데이터가 희박해지고, 거리 측정이 의미를 잃는다.

- 계산 복잡도: 높은 차원은 계산 자원을 많이 소모.

- 과적합: 노이즈가 포함된 차원이 모델 성능을 저하시킴.

차원 축소는 이러한 문제를 해결해 데이터를 간소화하고, 패턴을 더 명확히 드러낸다.

2. 차원 축소의 수학적 기법

2.1. 주성분 분석 (Principal Component Analysis, PCA)

- 수학적 원리: 데이터의 분산을 최대화하는 직교 기저를 찾아 데이터를 저차원 공간으로 투영.

- 공분산 행렬을 계산: ( \text{Cov}(X) = \frac{1}{n} X^T X ).

- 고유값 분해를 통해 고유벡터(주성분)와 고유값(분산)을 구함.

- 가장 큰 고유값에 해당하는 고유벡터로 데이터를 투영: ( Y = XW ).

- 특징: 선형 변환, 분산 보존에 초점.

- 응용: 이미지 압축, 데이터 시각화.

2.2. 특이값 분해 (Singular Value Decomposition, SVD)

- 수학적 원리: 행렬 ( X )를 ( X = U \Sigma V^T )로 분해. 여기서 ( \Sigma )는 특이값, ( U ), ( V )는 직교 행렬.

- 상위 ( k )개의 특이값과 벡터를 선택해 저차원 근사 행렬 생성.

- 특징: PCA의 일반화된 형태, 희소 행렬에서도 효과적.

- 응용: 추천 시스템(예: 넷플릭스), 텍스트 분석(잠재 의미 분석, LSA).

2.3. t-SNE (t-Distributed Stochastic Neighbor Embedding)

- 수학적 원리: 고차원 데이터의 이웃 구조를 저차원(2D/3D)에서 보존. 쌍대 확률 분포를 사용해 데이터 간 유사성을 모델링:

- 고차원에서 가우시안 분포, 저차원에서 t-분포로 유사성 비교.

- KL 발산을 최소화해 최적 투영 찾음.

- 특징: 비선형, 시각화에 특화.

- 응용: 고차원 데이터 시각화(예: 단어 임베딩).

2.4. 오토인코더 (Autoencoder)

- 수학적 원리: 신경망을 사용해 입력 데이터를 압축(인코더)하고 재구성(디코더). 손실 함수(예: MSE)를 최소화: [ L = \frac{1}{n} \sum_{i=1}^n (x_i - \hat{x}_i)^2 ]

- 잠재 공간(Latent Space)은 저차원 표현.

- 특징: 비선형, 데이터 특성에 따라 적응적.

- 응용: 이미지 노이즈 제거, 생성 모델.

2.5. UMAP (Uniform Manifold Approximation and Projection)

- 수학적 원리: 데이터의 위상 구조를 보존하며 저차원으로 투영. 리만 기하학과 그래프 이론 기반:

- 이웃 그래프를 생성 후, 저차원에서 유사 구조를 최적화.

- 특징: t-SNE보다 빠르고, 대규모 데이터에 적합.

- 응용: 생물정보학, 데이터 클러스터링.

3. 차원 축소의 중요성

- 효율성: 계산 비용 감소, 모델 학습 속도 향상.

- 노이즈 제거: 불필요한 차원을 제거해 모델 성능 개선.

- 시각화: 고차원 데이터를 2D/3D로 변환해 직관적 분석 가능.

4. 실제 응용 사례

- 컴퓨터 비전: PCA로 이미지 압축, t-SNE로 특징 시각화.

- 자연어 처리: SVD로 텍스트 데이터(예: TF-IDF 행렬) 차원 축소.

- 추천 시스템: SVD로 사용자-아이템 행렬 분해.

- 생물정보학: UMAP으로 유전자 데이터 클러스터링.

5. 도전 과제

- 정보 손실: 차원 축소로 일부 정보가 손실될 수 있음.

- 비선형 구조: PCA 같은 선형 기법은 비선형 데이터에 부적합.

- 하이퍼파라미터: t-SNE, UMAP은 퍼플렉서티(Perplexity) 등 설정 필요.

6. 결론

차원 축소는 고차원 데이터를 효율적으로 처리하는 AI의 핵심 기술이다. PCA, SVD는 선형 구조를, t-SNE, UMAP, 오토인코더는 비선형 구조를 다룬다. 이 기법들은 계산 효율성, 노이즈 제거, 시각화를 가능케 하며, 컴퓨터 비전, NLP, 추천 시스템에서 필수적이다. 차원 축소의 수학적 원리를 이해하면 AI 모델의 성능을 극대화할 수 있다.

'인공지능 수학' 카테고리의 다른 글

| AI에서 그래프 이론의 활용 사례 (0) | 2025.08.06 |

|---|---|

| 신경망의 활성화 함수 (1) | 2025.08.05 |

| 베이즈 정리가 AI에 미치는 영향 (3) | 2025.08.04 |

| 딥러닝 모델의 손실 함수와 수학적 원리 (0) | 2025.08.03 |

| 인공지능에서 사용하는 주요 수학 공식 5가지 (0) | 2025.08.02 |